実在しない参考文献が論文に混入 AI時代の学術出版に何が起きているのか

生成AIは、論文執筆や要約、文献探索の補助として急速に広がっています。

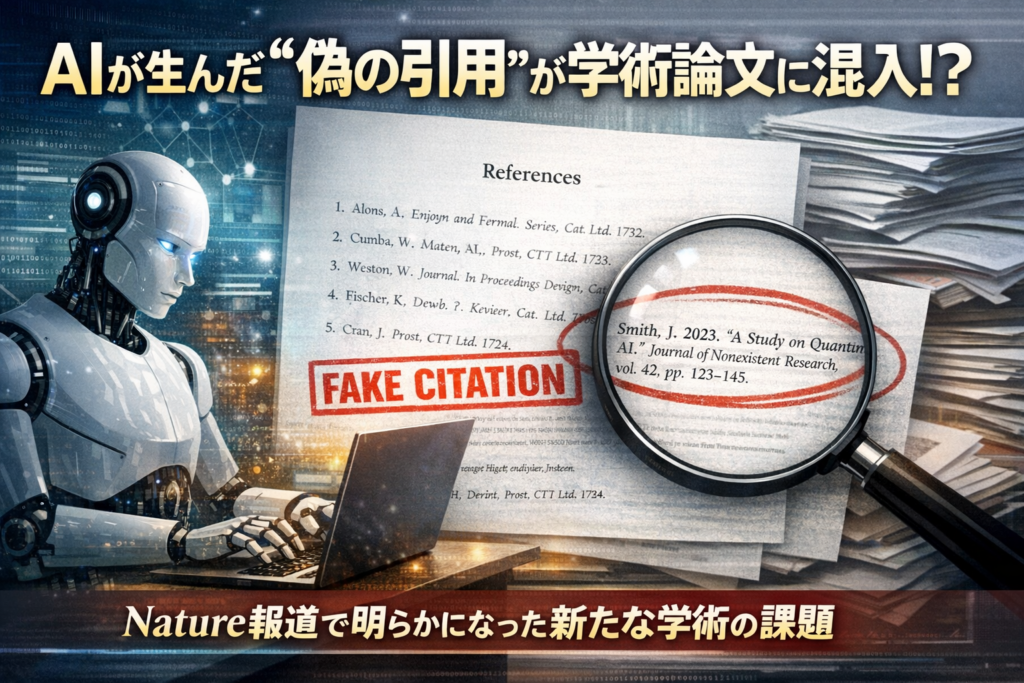

ただ、その便利さの裏で見逃せない問題になっているのが「幻覚引用」です。これは、もっともらしい体裁をしているものの、実際には存在しない論文や、著者名・年・誌名などが食い違っている参考文献を指します。Natureの最新記事は、この問題がすでに学術出版の現場で無視できない規模に達している可能性を報じました。

生成AIは、論文執筆や要約、文献探索の補助として急速に広がっています。

ただ、その便利さの裏で見逃せない問題になっているのが「幻覚引用」です。これは、もっともらしい体裁をしているものの、実際には存在しない論文や、著者名・年・誌名などが食い違っている参考文献を指します。Natureの最新記事は、この問題がすでに学術出版の現場で無視できない規模に達している可能性を報じました。

何が発表されたか

Natureによると、2025年に公表された論文の中には、AIが生成した無効な参考文献が数万件規模で含まれている可能性があります。記事では、研究不正の検出に取り組む研究者が、自分の論文がまったく異なる分野の論文から奇妙な形で引用されていることに気づいた事例も紹介されています。つまり問題は理論上の懸念ではなく、すでに実例が確認されているということです。重要なポイント

関連するプレプリント研究では、ACL、NAACL、EMNLPの2024〜2025年論文を調査した結果、少なくとも約300本に幻覚引用が見つかったと報告されています。しかもその大半は2025年論文に集中していました。別研究でも、2025年の主要会議予稿集のすべてで少なくとも1件の不審な引用が見つかったとされており、AI利用の拡大とともに、参考文献の品質管理が追いついていない現状がうかがえます。これはなぜ注目されるのか

学術論文において参考文献は、単なる飾りではありません。先行研究の確認、主張の裏づけ、研究の再現性や信用の土台になるものです。そこに偽の引用が混じると、読者は原典にたどり着けず、査読や研究評価の前提も崩れてしまいます。 そのため、学会や出版倫理の側でも対策が進みつつあります。ACLは、生成AIの利用は著者責任で透明に開示し、引用の正確性を満たす必要があるとしています。また、CrossrefやSemantic Scholar、OpenAlexなどを使って参考文献を照合するCheckIfExistやRefCheckerのような検証ツールも登場しています。まとめ

今回の論点は、「AIを使うべきか」ではなく、「AIを使った結果を誰がどこまで検証するのか」にあります。生成AIは文章作成の補助として有用ですが、参考文献の真偽まで自動で保証してくれるわけではありません。今後は、著者が原典確認を徹底すること、投稿・査読・編集の各段階で自動チェックを組み込むこと、そして誤りが出たときに迅速に訂正できる仕組みを整えることが、研究の信頼性を守るうえで重要になりそうです。2026年4月4日 2:24 AM カテゴリー: AI