AIが書ける時代に人間の創造性をどう測るか:埋め込み空間による新規性評価の提案

AIが、自然で読みやすい文章を書けるようになったとき、私たちは何をもって「この人は創造的だ」と判断できるのでしょうか。

企画書、志望動機、ケース課題、社内レポート。これまで多くの場面で、私たちは「書かれたもの」を通して、その人の考える力や発想力を見ようとしてきました。文章が論理的で、表現が整っていて、提案に説得力があれば、そこには書き手の能力が表れていると考えられてきたからです。

しかし生成AIの登場によって、この前提は少しずつ揺らぎ始めています。AIを使えば、誰でも一定以上に流暢な文章を作れる。そうなると、成果物の見た目の完成度は、必ずしも人間の創造性をそのまま映す鏡ではなくなります。

arXivに投稿された論文 Measuring Creativity in the Age of Generative AI は、この変化を正面から扱っています。テーマは、生成AI時代の創造性評価。特に、採用や人材評価のように「人の能力を見極める」場面で、AIが作れる流暢さと、人間ならではの独自性をどう区別するのかという問いです。

この論文が扱う問題

この論文が出発点にしているのは、生成AIが単なる文章作成ツールではなく、評価の前提そのものを変えつつあるという現実です。

企業の採用課題では、候補者にエッセイやケース分析を書かせることがあります。社内の人材評価でも、企画書やプロジェクト提案を通じて、その人の思考力や創造性を判断することがあります。教育の現場でも、レポートや課題文は学生の理解度を見るための重要な材料でした。

ところが、生成AIが普及すると、これらの成果物は以前よりも簡単に整えられます。文法は正しく、構成は自然で、論点もそれらしく並んでいる。評価者の目には「よくできた回答」に見えるかもしれません。

しかし、ここに矛盾があります。

文章がうまいことと、発想が独自であることは、同じではありません。

AIは、学習した膨大なテキストのパターンをもとに、もっとも自然でありそうな答えを生成します。その結果、多くの人が同じようなAIツールを使えば、回答は一定の品質にそろう一方で、似た方向へ収束していく可能性があります。

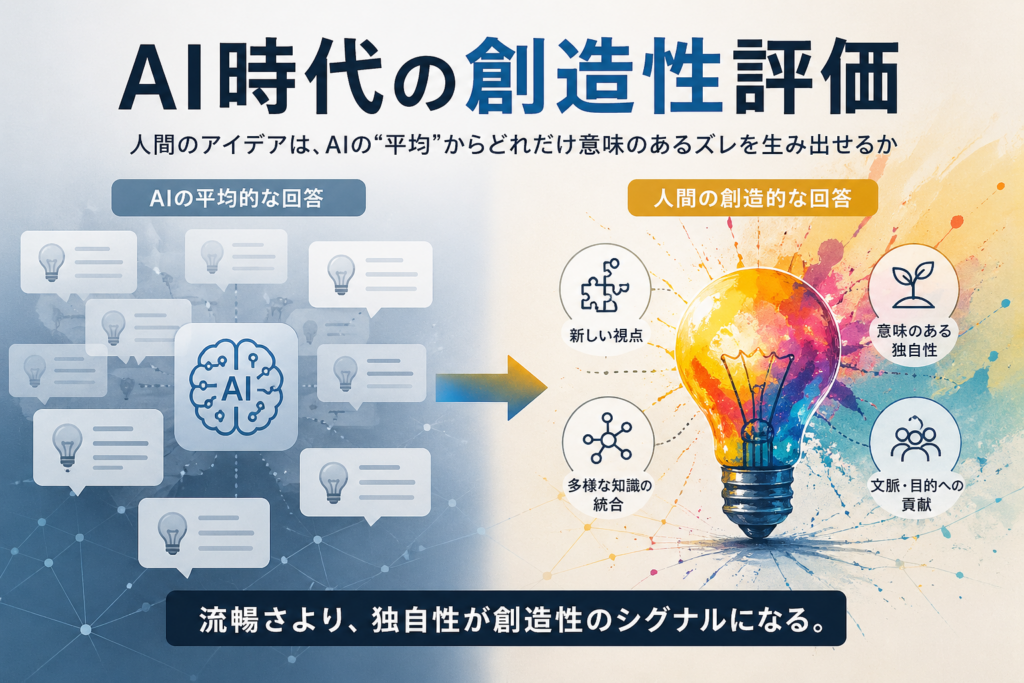

論文が注目するのは、まさにこの点です。生成AI時代には、「流暢であること」だけでは創造性の十分な証拠にならない。むしろ、AIが出しがちな平均的な答えから、どれだけ意味のある形で離れられるかが重要になるのではないか。著者らは、そうした問題意識から新しい評価の枠組みを提案しています。

提案された方法

著者らは、創造性を単に「新しいことを言う力」としては捉えていません。重要なのは、新しさだけでなく、複数の考えや知識をどう結びつけるかです。

論文では、創造性を「統合における新規性」として考えます。つまり、与えられた前提や情報を踏まえながら、そこからどの程度新しい方向へ展開しているか。そして、複数の要素をどれだけ広く、バランスよく組み合わせているかを見ようとします。

技術的には、文章やアイデアを埋め込み空間上のベクトルとして表現します。前提となる情報と回答を数値的な位置関係として扱い、回答が前提からどれだけ離れているか、また複数の前提をどの程度統合しているかを計算します。

ここで大切なのは、単に「変わったことを言えば高評価」という仕組みではないことです。無関係な方向に飛ぶだけでは、創造性とは言いにくい。論文が見ようとしているのは、文脈を保ちながら、そこに新しい視点や組み合わせを持ち込む力です。

これは、私たちの身近な仕事にも重なります。たとえば新規事業の企画では、ただ奇抜なアイデアを出すだけでは不十分です。市場、顧客、技術、組織の制約を踏まえたうえで、それまで見えていなかった接点を見つける必要があります。論文の提案は、そうした「意味のあるズレ」を定量的に捉えようとする試みだといえます。

主な結果

論文では、AIで生成した合成データセットを使って、提案指標の予備的な評価を行っています。40個の活動課題に対して、回答の創造性ラベルと提案スコアの対応を調べたところ、平均絶対誤差は0〜1スケールで平均0.20、Kendall相関は平均0.61、Pearson相関は平均0.76と報告されています。

著者らは、この結果から、提案した創造性スコアが直感的な創造性ラベルと一定程度整合すると述べています。

ただし、この結果は慎重に読む必要があります。実験で使われたデータやラベルは合成的に作られたものであり、人間の評価者が十分に検証した「正解」ではありません。論文でも、人間によるラベル付けデータでの検証は今後の課題として扱われています。

したがって、この研究は「創造性を完全に測れる方法ができた」と主張しているわけではありません。むしろ、生成AI時代に創造性をどう評価すべきかという問題に対して、ひとつの測定可能な方向性を示している段階だと見るのが適切です。

何が新しいのか

この論文の新しさは、創造性を成果物単体の品質ではなく、分布の中での位置として捉えている点にあります。

従来の評価では、文章の完成度や論理性、説得力が重視されがちでした。しかし、生成AIはまさにそのような流暢さを補うのが得意です。そうなると、評価すべき中心は「うまく書けているか」から、「AIの標準的な答えを超えて、どのような独自の統合があるか」へ移っていく可能性があります。

これは、採用や教育にとって小さな変化ではありません。

AIの利用を単純に禁止するのではなく、AIがあることを前提に、人間がどのような価値を加えているのかを見る。論文が示しているのは、そのような評価観の転換です。

限界と注意点

一方で、この研究には明確な限界もあります。

まず、実験が合成データに基づいている点です。人間が実際に創造的だと感じる回答と、AIが生成したラベルがどの程度一致するのかは、まだ十分に確認されていません。

また、埋め込み空間上で測れる新規性や統合性は、創造性の一部にすぎません。あるアイデアが社会的に価値を持つか、人の感情を動かすか、美的に優れているか、長期的に有用かといった側面は、この指標だけでは捉えきれません。

さらに、採用や人材評価に応用する場合には、公平性や説明可能性も重要です。どの言語で書かれた回答か、どの文化的背景を持つ候補者か、どの埋め込みモデルを使うかによって、スコアが影響を受ける可能性もあります。

特に日本語環境で使う場合、日本語特有の表現、暗黙の文脈、業界ごとの評価基準を踏まえた検証が必要になるでしょう。

日本の読者にとっての意味

この論文は、遠い研究室の中だけの話ではありません。

日本でも、採用課題、社内研修、大学レポート、企画コンペ、クリエイティブ制作など、成果物を通じて人を評価する場面は数多くあります。そこに生成AIが自然に入り込んでいくと、「この文章は本人が書いたのか」という問いだけでは不十分になっていきます。

より本質的なのは、「この人はAIを使える環境の中で、どんな視点を加えたのか」という問いかもしれません。

AIが平均的な答えを整えてくれるなら、人間の役割は、そこから一歩ずらすことにあります。ただし、それは単なる奇抜さではありません。文脈を読み、複数の知識をつなぎ、目的に合った形で新しい意味を作ることです。

この論文は、そうした創造性のあり方を、採用や人材評価の文脈から考え直すきっかけを与えてくれます。

まとめ

生成AIは、私たちの文章を整え、発想の幅を広げてくれます。その一方で、成果物だけを見て人間の能力を判断することを難しくもしています。

Measuring Creativity in the Age of Generative AI が示しているのは、創造性評価の焦点が「流暢さ」から「意味のある独自性」へ移っていく可能性です。AIが出しがちな平均的な答えから、どれだけ文脈に沿って新しい接続を作れるか。そこに、人間の創造的な貢献を見ようとしています。

もちろん、この研究はまだ予備的な段階です。実際の採用や教育に使うには、人間による評価、日本語での検証、公平性の確認が欠かせません。

それでも、この論文が投げかける問いは重要です。

AIがうまく書ける時代に、私たちは何を「人間の創造性」と呼ぶのか。

その答えは、これからの働き方や学び方、そして人を評価する仕組みの中で、少しずつ問われていくことになりそうです。

論文の基本情報

論文タイトル:Measuring Creativity in the Age of Generative AI: Distinguishing Human and AI-Generated Creative Performance in Hiring and Talent Systems

著者:Yigal Rosen, Ilia Rushkin

所属:Yigal Rosen は Massachusetts Institute of Technology & Ignis AI、Ilia Rushkin は Ignis AI と記載されています。

公開日:2026年4月10日 arXiv投稿

発表情報:BIG.AI@MIT Conference, April 2, 2026 で発表された研究ペーパーと記載されています。

掲載先:arXiv

査読状況:arXiv上の情報からは査読済みかどうかは確認できません。プレプリント/研究発表ペーパーとして読むのが安全です。

対象分野:Human-Computer Interaction、Artificial Intelligence、Computers and Society、Neurons and Cognition