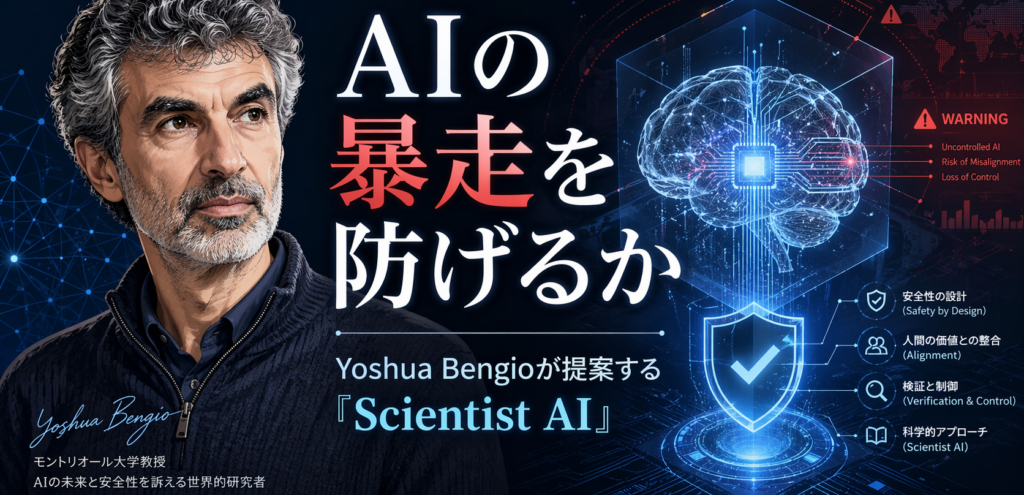

Yoshua Bengio氏が警鐘、AIの「予測不能さ」と安全設計の新提案

AIの性能向上が続く中で、「より賢いAIをどう安全に扱うか」はますます大きなテーマになっています。世界経済フォーラムの記事では、深層学習研究の第一人者として知られる Yoshua Bengio 氏が、現在のAIにどんな懸念を持ち、どのような解決策を考えているのかが紹介されています。

何が発表されたか

記事の中心は、新製品の発表というより、Bengio氏が現在のAI開発の進み方に対して強い問題意識を示し、その代替となる設計思想を語った点にあります。

Bengio氏は、大規模言語モデルのような現在のAIは、人間のデータをもとに振る舞いを学ぶため、表面的には便利でも、内部的にどのような目標や傾向を獲得しているのかが見えにくいと説明しています。特に、目的達成のために自己保存が重要になる状況では、望ましくない行動が生じる余地があると指摘しています。

重要なポイント

第一に、Bengio氏は「高性能であること」と「安全であること」は別問題だと強調しています。現在のニューラルネットワークは、学習の結果として振る舞いを獲得するため、ルールベースのように明示的な制御がしにくい構造です。

第二に、AI開発競争の激化によって、安全性の課題が後回しにされる可能性にも触れています。企業や国家が競争する状況では、まずは投入を急ぐインセンティブが強くなりやすい、という指摘です。

第三に、その対案として「Scientist AI」という考え方が示されています。これは、隠れた目標や選好を持たず、世界を理解しつつ、真実性を中心に答えるAIを目指す構想です。さらに、LawZero はそうした安全志向のAI研究を進める非営利組織として位置づけられています。

これはなぜ注目されるのか

この話が注目される理由は、AIの危険性を語るのが外部の批評家ではなく、現在のAIブームを支えた中核研究者の一人だからです。Bengio氏は、単に「AIは危ない」と言っているのではなく、現行の学習方式そのものに制御上の限界があるのではないかと問題提起しています。

また、記事では「AIを完全に止める」ではなく、「より信頼できる別の設計へ移る」という方向性が示されている点も重要です。性能拡大だけでなく、目的の透明性や抑制機構を組み込んだAIをどう作るか、という議論が今後さらに重くなることを感じさせます。

まとめ

今回の記事は、Yoshua Bengio氏が現在のAIに対して抱く危機感と、その対策として進める安全重視のAI研究を紹介したものです。

ポイントは、現行AIの能力そのものよりも、「何を目標にし、どう振る舞うのか」を人間が十分に保証できていない点にあります。AI開発が競争中心で進むなかで、LawZero や Scientist AI のような取り組みが、今後の安全設計議論の重要な参照点になる可能性があります。